AIGC时代,DLP怎么办?看新晋Gartner SSE霸主如何操作

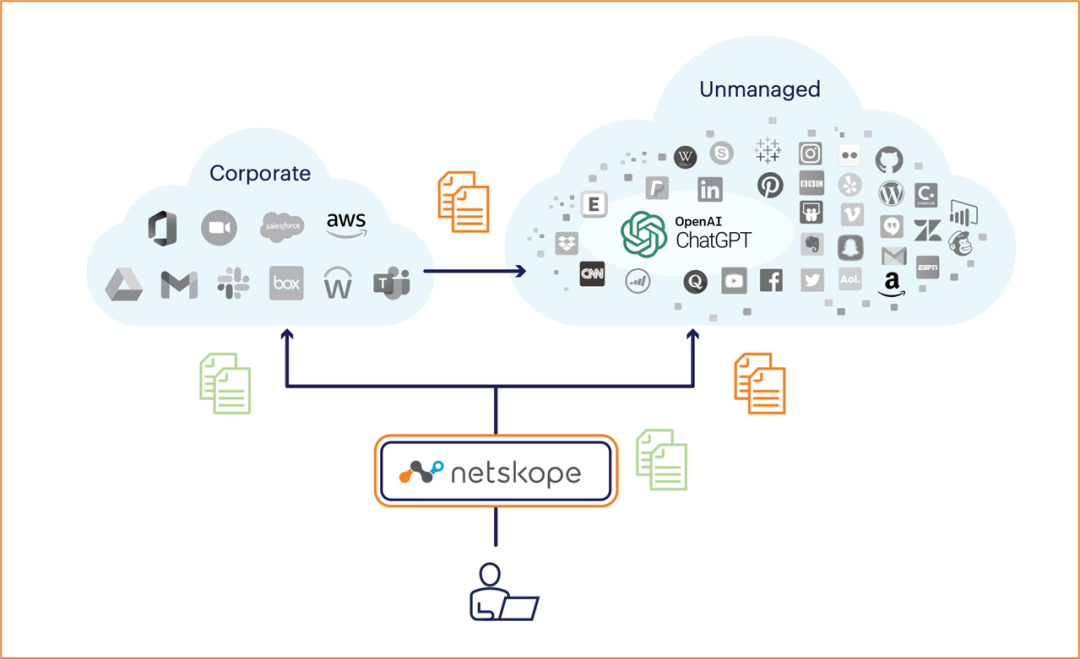

责编:gltian |2023-07-11 17:03:302023年6月20日,SASE/SSE领先提供商Netskope今天宣布推出一款全面的数据保护解决方案,帮助企业安全管理员工使用ChatGPT和其他生成式人工智能应用,如Google Bard和Jasper。

鉴于2023年发生的生成式人工智能导致敏感数据曝光的事件,许多企业开始对AI使用中的数据安全格外重视,考虑如何在不将业务置于风险中的情况下安全启用这些应用并支持人工智能创新。根据Netskope的研究,目前情况如下:

- 约有10%的企业组织正在积极阻止团队使用ChatGPT

- ChatGPT在企业中的采用呈指数增长,每月增长率为25%

- 大约每100名企业员工中有1名每天积极使用ChatGPT,每位用户平均每天提交8个prompts

为了解决这一挑战,Netskope Intelligent SSE结合了早已被业界认可的Netskope数据保护功能、和专门用于分类和动态控制生成式人工智能应用安全使用的最新创新。

“当今企业面临决策是否阻止访问ChatGPT和其他生成式人工智能应用以减少安全风险,还是允许使用并获得这些应用带来的效率和其他好处。这些应用的安全启用最终是一个高级数据保护挑战,而Netskope正处于独特的解决位置。”Netskope的联合创始人兼CTO Krishna Narayanaswamy表示。“Netskope通过使用适当的数据保护控制,帮助所有组织鼓励对这些日益流行的应用程序负责任地使用,从而确保业务的安全和高效。”

我们一起来看下演示视频,感受下Netskope的能力。

作为智能SSE的一部分,Netskope的Zero Trust引擎能够安全启用生成式人工智能应用,包括以下功能:

全面的应用程序使用可见性

- 通过行业上最广泛的SaaS发现(使用动态数据库包含60,000多个应用程序)和高级分析仪表板,即时访问组织内特定ChatGPT的使用情况和趋势

- 最佳的Cloud Confidence Index™ (CCI),能够主动对新的生成式人工智能应用进行分类并相应评估其风险

- 通过专利的Cloud XD™检查,提供精细的上下文和实例感知能力,识别应用程序账户中的访问级别和数据流动,例如企业账户与个人账户之间的区分

- 通过专门为识别生成式人工智能域名而创建的新的Web类别,实现可见性,使团队能够配置访问控制和实时保护策略,并管理专门用于生成式人工智能应用程序的流量

高级应用程序访问控制

- 动态进行对ChatGPT和其他AIGC应用程序的精细访问控制

- 实时显示辅助指导消息,每次访问生成式人工智能应用程序时提醒用户潜在的数据曝露和其他风险,促进生成式人工智能应用程序的负责任使用,并实时培训员工,无需停止无害的查询

先进的数据保护

- 监控、允许或阻止将企业敏感数据(如源代码)发布到AI聊天机器人

- 使用先进的数据分类器和基于机器学习的检测,支持符合GDPR、CCPA、HIPAA等法规合规需求

AI时代的数据安全

AI浪潮同样在席卷国内所有行业,如何保障未来AIGC语境下的数据安全,同样也成为国内甲方高度关注的一个话题。部分国内明星厂商已经前瞻性布局,并开始探索自己的特色实践。

亿格云CEO葛岱斌表示,早在ChatGPT之前,AI和机器学习的技术已经广泛被应用在安全的各种领域,如亿格云的亿格云枢平台,在威胁检测和数据安全检测的时候,也大量到采用了机器学习的技术。机器学习和人工智能可以用来处理海量的威胁线索,自动处理生成真实的威胁情报。同时在数据安全的场景下,机器学习可以用于对敏感文件的特征进行提取并识别可能存在的敏感数据泄漏等问题。而基于大模型算法的ChatGPT,更是把战场从大量的自动化分析拓宽到人工的高级分析的场景,原本对于高级威胁事件的判定到如何处置对于安全运维人员来说一直是最具挑战的事情,因为这些工作需要经年累月的经验。而ChatGPT最擅长的就是把这些需要经验且“有套路”的工作自动化智能化。训练后的GPT模型可以大幅降低安全产品对于安全人员专业的门槛,甚至是帮助企业来培养安全人员,形成真正的人机共治理。

作为一个领先的云安全厂家,亿格云也对新的AI技术保持着持续的投入和关注。在今年3月,也发布了基于GPT技术的“智能风险分析”的功能,让用户可以使用最新的AI技术为自己的企业安全保驾护航。

薮猫科技产品总监孟晨认为,随着大语言模型(LLM)的成熟以及人工智能生成内容(AIGC)的普及,越来越多的企业员工开始使用 ChatGPT 等人工智能应用来提高工作效率。然而,此番热潮之下,逐渐暴露出一个严重问题:在使用 ChatGPT 提高工作效率的过程中,员工可能在不经意间泄露大量企业的内部敏感数据。

例如,此前三星通报了公司内部严重的信息泄露事故:有员工将公司内部源码传至ChatGPT 进行 Debug,还有传会议内容至ChatGPT 制作会议记录。

基于此,国内外不少公司、机构都相继明令禁止员工使用 ChatGPT。时代的发展离不开技术的革新换代,当下的禁用或许能带来短暂的「安全」,但不一定是最优解。如何在安全可控的情况下,让技术为社会发展、工作效率提速或许是我们需要进一步思考的问题。

薮猫科技认为任何技术发展的双刃剑,离不开规范与管控。基于此,青骓 DDR 提供精准的数据流向监控与泄露防护响应功能,可有效管理 AI 应用的使用。根据企业办公安全标准,提供包括但不限于:审批后访问、弹窗警示、阻断访问在内的多种防护功能,对风险做好:事前及时提醒、事中发现响应、事后追踪溯源,灵活保障员工安全地使用 ChatGPT 等 AI 应用进行提效。

「Netskope for ChatGPT and Generative AI Data Protection」获取方式如下:

1.关注【安全喵喵站】公众号

2.后台发送关键词【Netskope】即可获取下载链接

相关链接:

https://www.netskope.com/press-releases/netskope-enables-secure-enterprise-use-of-chatgpt-and-generative-ai-applications-with-first-of-its-kind-solution#_ftn1

https://www.darkreading.com/application-security/netskope-enables-secure-enterprise-use-of-chatgpt-and-generative-ai-applications

https://www.netskope.com/blog/modern-data-protection-safeguards-for-chatgpt-and-other-generative-ai-applications

https://www.netskope.com/blog/build-a-culture-and-governance-to-securely-enable-chatgpt-and-generative-ai-applications-or-get-left-behind

https://www.netskope.com/solutions/netskope-for-chatgpt-and-generative-ai

来源:安全喵喵站