1.前言

在现实生活中,恐怖分子嵌入秘密指令的载体往往是彩色图像而不是灰度图像,本文经过调查研究,提出一个针对彩色图像的隐写检测分析方案,具有很好的隐写检测正确率。

2.研究内容

2.1图像表示规范

给一个RGB真彩色图像X,它的大小是MxN。X被表示为红、绿、蓝三个颜色通道{X1,X2,X3},其中![]() ,

,![]() ,

,![]() ,

,![]() ,

,![]() 。隐写算法被应用于彩色图像上,相当于将+1或-1的隐写噪声添加到每个颜色通道上。因此,经过隐写后,彩色图像X的每个颜色通道可以被表示为

。隐写算法被应用于彩色图像上,相当于将+1或-1的隐写噪声添加到每个颜色通道上。因此,经过隐写后,彩色图像X的每个颜色通道可以被表示为![]() ,其中

,其中![]() ,

,![]() 表示对应的颜色通道,

表示对应的颜色通道,![]() ,

,![]() 表示添加的隐写噪声。对于一个原始图像,

表示添加的隐写噪声。对于一个原始图像,![]() ,

,![]() 的值都是0,表示未添加隐写噪声。

的值都是0,表示未添加隐写噪声。

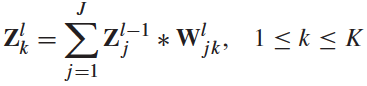

2.2两种卷积方式

所有的深度学习隐写分析都基于卷积神经网络CNN。CNN的主要部分是不断交替使用的卷积层、正则层和池化层的堆叠体,在它们的最顶部即最后输出结果的位置是可选的多个全连接层。卷积层是CNN的核心组成部分。对于一个卷积层,设当前卷积层是![]() ,它将上层J通道的输出特征图

,它将上层J通道的输出特征图![]() ,

,![]() 作为输入,与JxK个卷积核

作为输入,与JxK个卷积核![]() 做卷积运算生成一个K通道的输出

做卷积运算生成一个K通道的输出![]() ,

,![]() 。在图像隐写分析领域,

。在图像隐写分析领域,![]() ,

,![]() 和

和![]() 是一个二维矩阵。标准卷积运算可表示为:

是一个二维矩阵。标准卷积运算可表示为:

如下图。

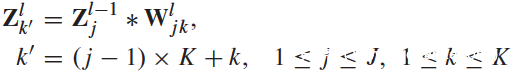

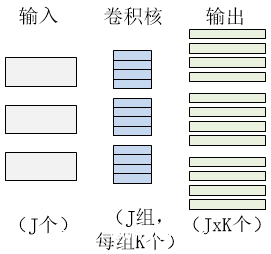

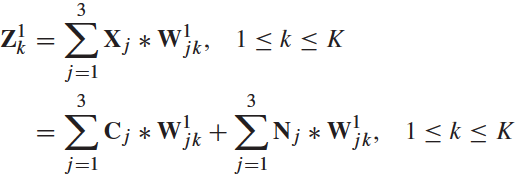

设计一种通道级别的卷积运算方式,它是标准卷积运算的一个变体。在通道级别的卷积运算方式中,输入变量的每个通道与K个卷积核做运算后生成对应K个通道的值,这样当输入变量是J个通道时,输出特征图的通道数为JxK,此时卷积可表示为:

如下图。

2.3两种卷积方式对隐写分析的贡献

对于隐写分析工作,彩色隐写图像的三个颜色通道相同位置的强度值显示出很强的相关性。从统计的角度来看,它们的均值(或期望)相似,但颜色通道间由隐写噪声+1或-1造成的差异非常小。

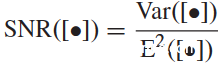

设E([·])和Var([·])表示矩阵[·]的期望和方差,Corr([·], [·])表示矩阵[·]和[·]的相关性。在隐写分析领域信噪比SNR可表示为:

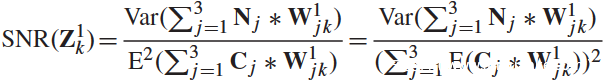

对于标准卷积,对彩色隐写图像做卷积运算生成一个K通道的输出特征图,则计算过程可表示为:

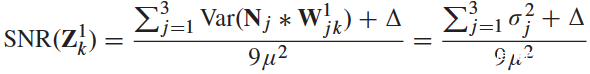

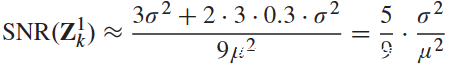

此时,信噪比可表示为:

设![]() ,

,![]() ,已知彩色图隐写术将隐写信号尽可能均匀地嵌入到三个颜色通道中,因此,设

,已知彩色图隐写术将隐写信号尽可能均匀地嵌入到三个颜色通道中,因此,设![]() ,

,![]() ,则

,则

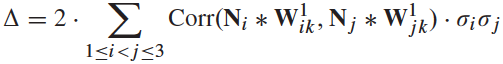

因为卷积运算属于线性变换类别,而线性变换不会影响变量的相关性,因此,

已知对于彩色隐写图,经统计各通道相同位置隐写噪声的相关性不超过0.3,因此设置![]() 。则:

。则:

而对于通道级别的卷积运算方式,则不存在通道间隐写噪声相关性的比较,对于每个颜色通道,有:

分析可知,![]() ,

,![]() ,标准卷积确实削弱了信噪比,通道级别的卷积运算方式则有效地提高了信噪比。因此,标准卷积能保留隐写图内容的相关性,却削弱了隐写噪声,而通道级别的卷积运算方式则有效地保留了隐写噪声。

,标准卷积确实削弱了信噪比,通道级别的卷积运算方式则有效地提高了信噪比。因此,标准卷积能保留隐写图内容的相关性,却削弱了隐写噪声,而通道级别的卷积运算方式则有效地保留了隐写噪声。

2.4隐写分析模型

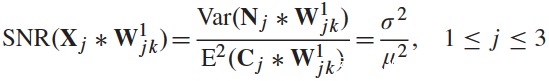

在模型底层即输入彩色图的位置,使用通道级别的卷积运算方式能更好地保留隐写图像的隐写特征,并选择空域富模型的高通滤波器初始化卷积核从而更好地提取隐写特征。在之后的卷积层中,连接特征图,使用标准卷积保留并训练丰富的隐写特征内容。最后使用全连接层汇聚特征做预测。

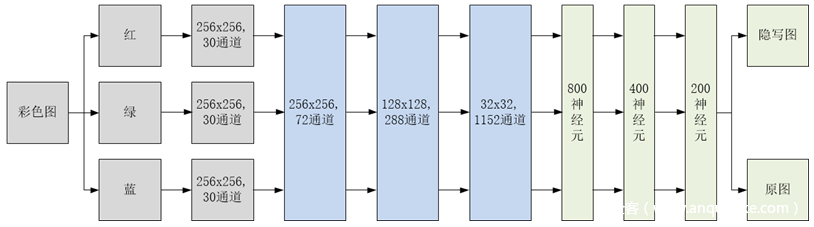

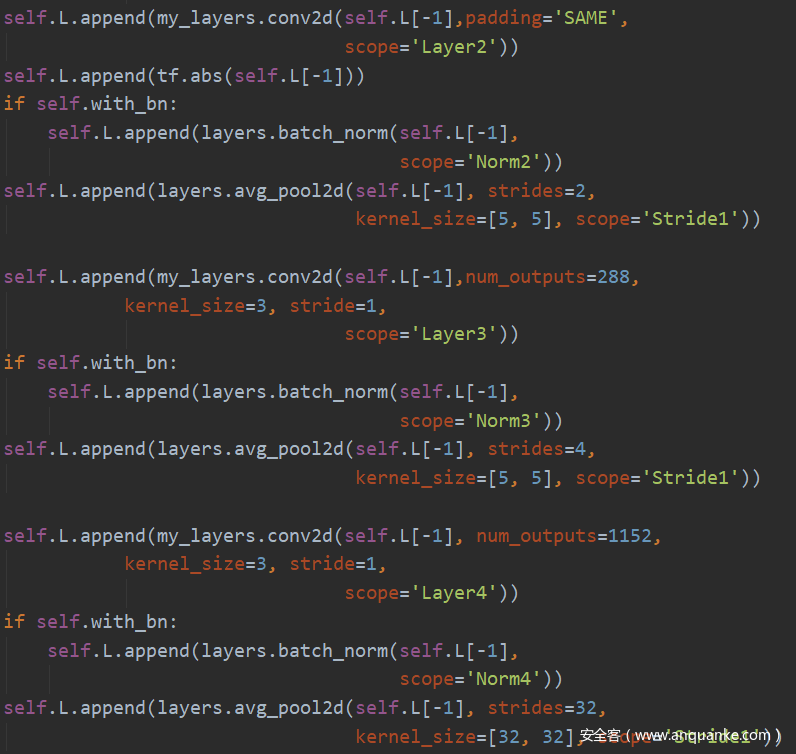

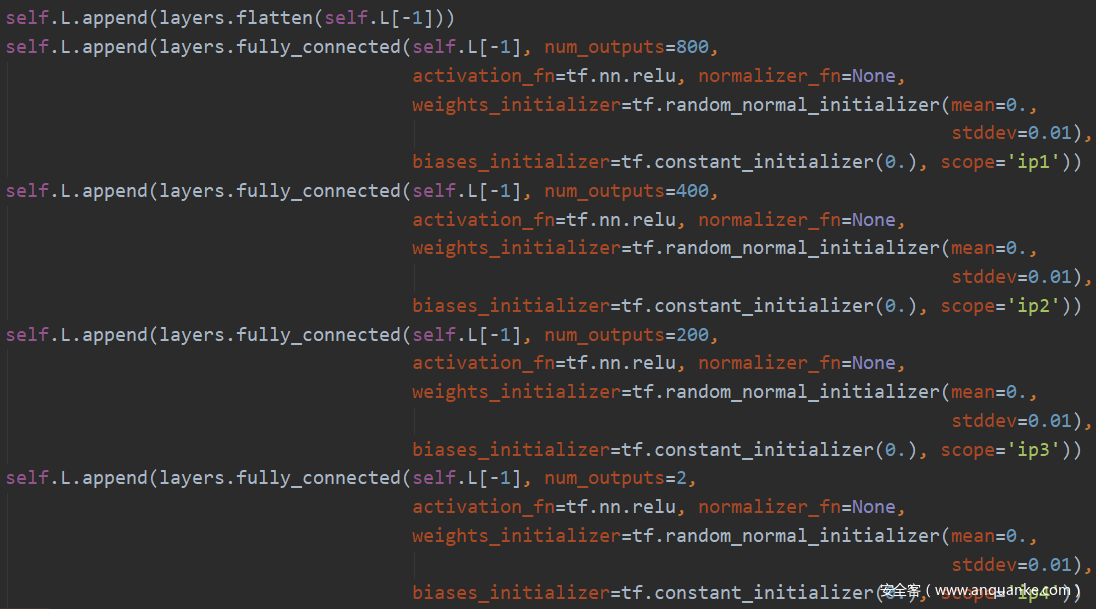

模型基本架构如下图。模型将真彩色图像作为输入,并对输入图像的红色、绿色和蓝色通道分别应用通道级别的卷积运算方式。在这一过程,分配给每个通道的卷积核权重通过SRM中的30个高通滤波器进行初始化,以提高信噪比。因此,每个通道与三十个5 x 5的已初始化的卷积核权重矩阵进行卷积,并对应生成三十个通道的特征图。注意,在训练过程中,本文将卷积核权重矩阵设置为可学习模式,即在训练过程中权重矩阵值会随着训练而变化。然后将三个独立的输出通道组连接在一起,以形成第二个卷积层的90通道的输入特征图。

从第二个卷积层开始,即应用标准卷积运算方式。在这一阶段,正常的卷积层中结构依次是卷积运算层、BN层、ReLU层和平均池化层,在第一个正常卷积层中添加了绝对值操作获取卷积运算后的绝对值。因为预处理层得到的隐写残差信息经过卷积运算后具有符号对称性,取其绝对值更有利于增强模型的特征表达。在此阶段中,从底部到顶部的正常卷积层的输出特征图的大小分别为256 x 256、128 x 128和32 x 32。为了保持每个卷积层的复杂度从而更好地进行隐写特征的提取和处理,将每个卷积层中的卷积核数相应地增加了四倍,这样,输出特征图的数量分别为72 ,288和1152。在最顶部的正常卷积层后面,将输出特征图以32的步幅合并,合并后的特征向量作为全连接网络的输入。在最高层的全连接网络中,所有三个隐藏层都使用ReLU激活功能,最后一个全连接层包含两个神经元表示预测的正常图像和隐写图像的结果。

在卷积网络的顶部,有一个四层全连接神经网络,可以汇聚特征进行最终的分类预测。全连接网络层分别包含800、400、200和2个神经元。

网络结构的核心代码如下:

本文实验的数据源是BOSSBase v1.01,将其图像集通过转换和隐写操作生成1000对彩色的原始图像和隐写图像。mini-batch随机梯度下降方法训练模型,设置batch_size为16,设置学习率为0.001。在10000对原始图像和隐写图像中,随机选择5000对用于训练,1000对用于验证,4000对用于测试。

2.5底层优化的卷积核对隐写性能的贡献

在模型底层通道级别的卷积运算中,卷积核数值使用高通滤波器初始化后,还会随着网络的训练过程不断优化,最终有效地提升模型的隐写分析性能。但这里优化的详细作用一直众说纷纭。本文针对当前模型解释这一优化的详细作用。

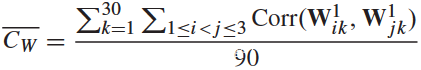

自从提出了空域富模型SRM以来,模型多样性对于隐写分析的性能至关重要。因此,本文认为本隐写分析模型的性能提高归功于模型底层卷积层中经过不断学习和优化卷积核带来的模型多样性,并认为底层卷积层的卷积核不能有效地提升信噪比。下面详细展开说明。

底层卷积核可分为三个通道的卷积核,记为![]() ,

,![]() ,则不同通道卷积核权重的相关性的平均值可记为:

,则不同通道卷积核权重的相关性的平均值可记为:

![]() 可用于评估底层卷积核的多样性,其值越小,则卷积核相关性越弱,多样性越丰富。初始状态下

可用于评估底层卷积核的多样性,其值越小,则卷积核相关性越弱,多样性越丰富。初始状态下![]() ,

,![]() 是SRM中的高通滤波器,因此初始状态下

是SRM中的高通滤波器,因此初始状态下![]() ,表示卷积核相关性最强,多样性差。在训练过程的模型验证中,随着模型性能提升,发现卷积核权重通过学习不断更新数值,然而

,表示卷积核相关性最强,多样性差。在训练过程的模型验证中,随着模型性能提升,发现卷积核权重通过学习不断更新数值,然而![]() 却不断减小,说明更新后的卷积核多样性越来越丰富,卷积核多样性和模型的性能是正相关的。

却不断减小,说明更新后的卷积核多样性越来越丰富,卷积核多样性和模型的性能是正相关的。

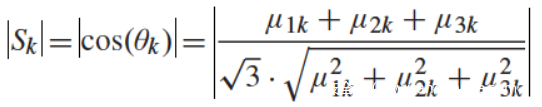

在上文中有提到隐写分析领域信噪比SNR的计算方法,其中假设![]() ,则对于一个图像定义

,则对于一个图像定义![]() ,

,![]() ,则

,则![]()

![]()

![]()

![]()

![]() 。设

。设![]() 是

是![]() 与

与![]() 的夹角,夹角的变化程度可通过余弦相似度的绝对值来表示:

的夹角,夹角的变化程度可通过余弦相似度的绝对值来表示:

当![]() 与

与![]() 的夹角越逼近时,

的夹角越逼近时,![]() 越接近1,在初始状态

越接近1,在初始状态![]()

![]()

![]() 。在训练过程的模型验证中,可知

。在训练过程的模型验证中,可知![]() 一直逼近1而没有什么明显的升降趋势,这有力地证明了在训练过程中,

一直逼近1而没有什么明显的升降趋势,这有力地证明了在训练过程中,![]() 一直逼近0,即

一直逼近0,即![]() 约等于

约等于![]() ,则

,则![]() ,因此对于本模型,前述信噪比SNR的假设是合理的,推导过程是正确的。

,因此对于本模型,前述信噪比SNR的假设是合理的,推导过程是正确的。

所以,底层卷积层的卷积核权重通过不断优化,增加了卷积核权重的丰富性,这有效地提升了模型的隐写分析性能。

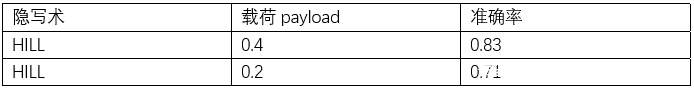

2.6实验结果

对图像集做了HILL隐写术操作和隐写分析,结果如下,可知隐写分析模型具有良好的准确率。

核心网络代码链接:

https://github.com/HYWZ36/Color_Steganalysis

参考资料:

http://dde.binghamton.edu/download/ImageDB/BOSSbase_1.01.zip

https://ieeexplore.ieee.org/document/7109899

https://ieeexplore.ieee.org/document/7342902

https://ieeexplore.ieee.org/document/8664587

https://ieeexplore.ieee.org/document/7084325